La numérisation de la sécurité nationale : technologie, transparence et confiance

Table des matières

- Membres du Groupe consultatif sur la transparence de la sécurité nationale (GCT-SN) au moment de la publication de ce rapport

- Sommaire

- 1. Introduction

- 2. La sécurité nationale et l'expansion du paysage numérique

- 3. Conclusions et recommandations

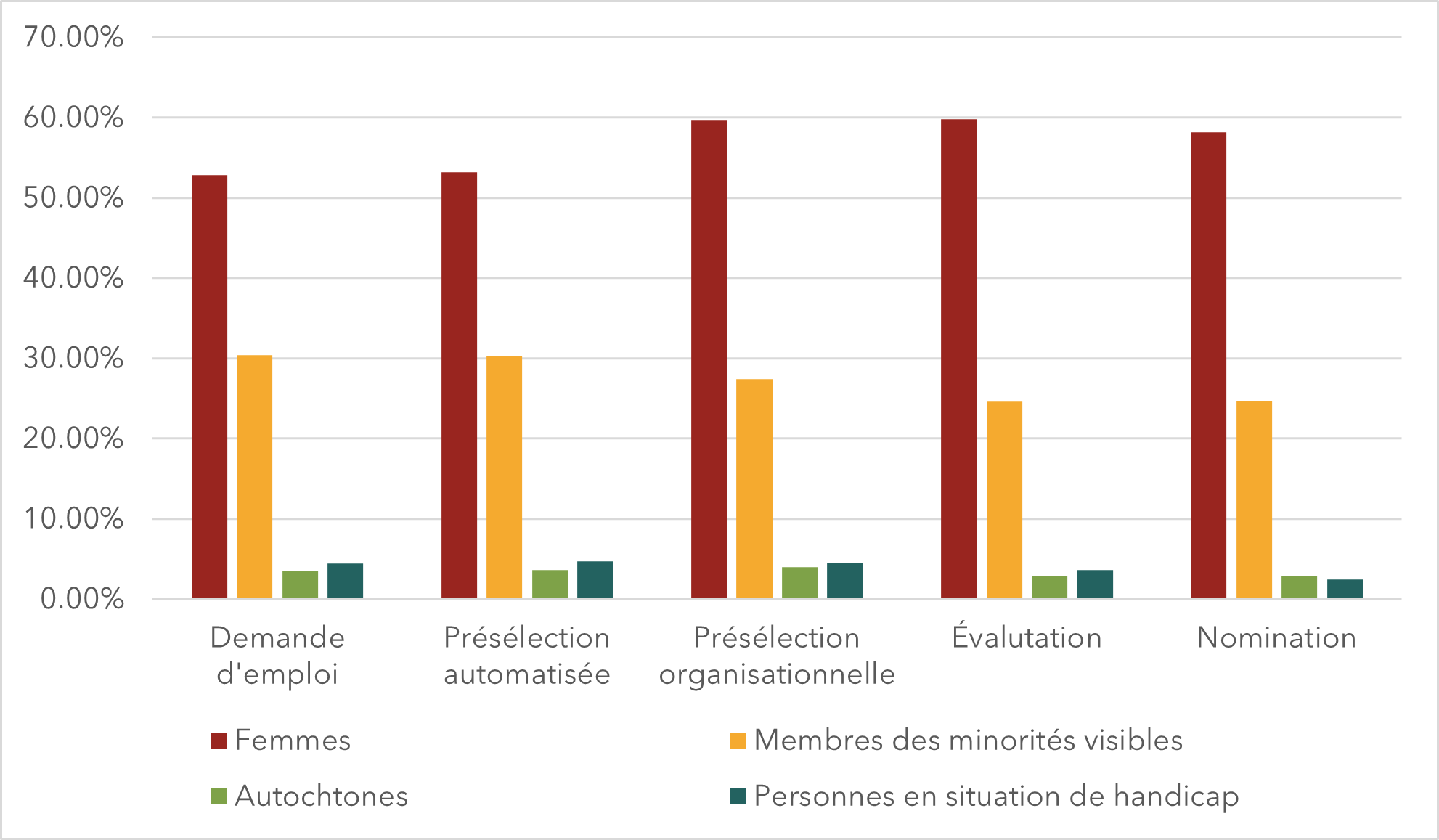

- Annexe A : Infographie sur la diversité et l'inclusion au sein du milieu de la sécurité nationale

- Annexe B : Réponse de l'ASFC au deuxième rapport du GCT-SN, « Comment les institutions de sécurité nationale et de renseignement collaborent avec les communautés racialisées »

- Annexe C : Aperçu des réunions du GCT-SN d'octobre 2022 à mai 2023

- Annexe D : Cadres de transparence

Membres du Groupe consultatif sur la transparence de la sécurité nationale (GCT-SN) au moment de la publication de ce rapport :

John Ariyo, directeur général, Secrétariat de la Charte de Scarborough, Université de Toronto

Chantal Bernier, avocate-conseil au sein du groupe sur la vie privée et la sécurité de Dentons Canada

Amira Elghawaby, représentante spéciale du Canada pour la lutte contre l'islamophobie

Mary Francoli (coprésidente), doyenne associée et directrice, Collège des affaires publiques Arthur Kroeger

Daniel Jean, ancien conseiller auprès du premier ministre en matière de renseignement et sécurité nationale

Stéphane Leman-Langlois, professeur de criminologie à l'Université Laval et membre du Centre de sécurité internationale de l'École supérieure d'études internationales de l'Université Laval

Rizwan Mohammad, chercheur, spécialiste de l'engagement civique et responsable de la défense des droits au sein du Conseil national des musulmans canadiens

Jeffrey Roy, professeur à l'École d'administration publique de la Faculté de gestion de l'Université Dalhousie

Patrick Boucher (coprésidente gouvernementale), sous-ministre adjoint principal du Secteur de la sécurité et de la cybersécurité nationale de Sécurité publique Canada

Jillian Stirk, ancienne ambassadrice et sous-ministre adjointe à Affaires mondiales Canada

Lorelei Williams, militante autochtone et fondatrice de Butterflies in Spirit

Sommaire

Le Groupe consultatif sur la transparence de la sécurité nationale (GCT-SN) a été créé en 2019 en tant qu'organe indépendant et externe. Il a pour rôle de conseiller le sous-ministre de la Sécurité publique, et toute la communauté de la sécurité nationale et du renseignement, sur les mesures à prendre pour intégrer la transparence dans les politiques, les programmes et les activités du Canada en matière de sécurité nationale de manière à accroître la responsabilité démocratique et la sensibilisation du public.

Les consultations que nous avons menées au cours des quatre dernières années ont été largement ponctuées de références à l'évolution du paysage technologique. Outre l'explosion de la quantité d'information et de données à la disposition du milieu de la sécurité nationale et des Canadiens, les capacités accrues en matière de numérisation ont engendré de nouvelles possibilités et de nouveaux défis qui doivent être abordés avec beaucoup de prudence et dans une optique de transparence afin de ne pas miner davantage la confiance fragile que les Canadiens accordent aux organismes chargés de la sécurité nationale.

S'il était déjà question de la numérisation dans les trois premiers rapports du GCT-SN, ce quatrième rapport l'aborde plus en profondeur. Cela dit, il faut reconnaître que la numérisation est un sujet vaste et complexe. Il est difficile de rendre compte d'une telle complexité dans le cadre d'un rapport. Le présent rapport n'entend donc pas être exhaustif. Il présente plutôt un échantillon des risques, défis et possibilités liés à la numérisation qui ont été soulevés par de multiples intervenants au fil du temps.

Ce rapport est divisé en trois sections. La première section est une introduction qui vise à mettre en contexte la numérisation en ce qui a trait à la transparence, la confiance et l'ouverture. La deuxième section aborde certains des principaux risques, des principaux défis et des principales possibilités issus de l'expansion du paysage numérique dans le domaine de la sécurité nationale. Enfin, la troisième section revient sur l'Engagement de transparence en matière de sécurité nationale du gouvernement du Canada et propose quelques recommandations spécifiques aux organismes chargés de la sécurité nationale en vue de leur adoption.

Le Groupe consultatif sur la transparence de la sécurité nationale (GCT-SN) a été créé en 2019 en tant qu'organe indépendant et externe. Il a pour rôle de conseiller le sous-ministre de la Sécurité publique, et toute la communauté de la sécurité nationale et du renseignement, sur les mesures à prendre pour intégrer la transparence dans les politiques, les programmes et les activités du Canada en matière de sécurité nationale de manière à accroître la responsabilité démocratique et la sensibilisation du public.

Dans notre premier rapport, publié en 2020, nous avons présenté un survol de l'état de la transparence dans le milieu de la sécurité nationale du Canada et avons souligné les éléments à améliorer.

Dans notre deuxième rapport, publié en 2021, nous avons exposé les principes relatifs à la définition, à la mesure et à l'institutionnalisation de la transparence dans la communauté de la sécurité nationale et du renseignement.

Dans notre troisième rapport, publié en 2022, nous nous sommes penchés sur la manière dont les institutions de sécurité nationale et de renseignement collaborent avec les communautés racialisées et avons formulé diverses recommandations visant à combler le manque de confiance qui existe entre les institutions de sécurité nationale du pays et les Canadiens.

1. Introduction

L'omniprésence croissante des technologies numériques dans la société engendre plus que jamais des défis pour les gouvernements qui doivent d'une part répondre aux nouvelles menaces et aux risques accrus, et d'autre part chercher à tirer parti des nouvelles possibilités offertes par la numérisation. La numérisation de la sécurité nationale découle essentiellement de l'augmentation exponentielle des capacités technologiques permettant de renforcer la protection de la sécurité nationale ainsi que de la nécessité d'actualiser la protection contre les cybermenaces actuelles et futures que pourraient entraîner des technologies émergentes, notamment l'intelligence artificielle, le moissonnage du Web, la reconnaissance faciale et l'analyse prédictive. Dans ce contexte dynamique qui connaît une évolution rapide, l'objectif principal du présent rapport est d'examiner le caractère essentiel de l'ouverture et de la transparence en tant qu'agents d'habilitation essentiels de l'innovation, de la responsabilité et de la confiance du public, alors que la sécurité nationale et la numérisation sont de plus en plus inextricablement liées. Ce faisant, nous cherchons à demander au gouvernement du Canada de rendre compte du respect et de l'application de ses propres principes inscrits dans l'Engagement de transparence en matière de sécurité nationale.

L'expansion massive de l'information et des données, tant au sein du secteur public que dans l'ensemble de notre société interconnectée et en ligne, se trouve au cœur de la transformation numérique de la sécurité nationale qui en est encore à ses balbutiements. Étant donné que les appareils mobiles et les plates-formes numériques sont le moteur de cette expansion, de nombreux aspects des gouvernements traditionnels sont mis à l'épreuve, notamment les principes directeurs du contrôle de l'information et du secret. Comme nous l'avons observé dans notre premier rapport du GCT-SN :

Dans le milieu de la sécurité nationale, le réflexe dominant consiste à garder l'information aussi secrète que possible; l'approche par défaut est habituellement de protéger l'information. Bien que cela soit parfois nécessaire, les efforts visant à améliorer la transparence doivent s'accompagner de changements apportés à cette culture du secret. […] Ce manque de transparence peut avoir des conséquences imprévues, car le manque d'information risque davantage d'être comblé par de la désinformation ou d'éveiller les soupçonsNote de bas de page 1.

Depuis la publication de notre premier rapport, un rapport sur les conclusions d'une enquête du Commissariat à la protection de la vie privée du Canada (CPVP) a mis en lumière l'utilisation par la GRC, jusque-là non divulguée, de la technologie de reconnaissance faciale de Clearview AINote de bas de page 2. Il confirme nos préoccupations en matière de transparence liées à l'expansion des capacités technologiques des organismes chargés de la sécurité nationale.

La désinformation et la haine en ligne, l'ingérence électorale et le nombre croissant d'atteintes à la protection des renseignements personnels et de cyberattaques dans tous les secteurs témoignent de cet environnement dangereux dans lequel les données et l'information sont utilisées comme arme à petite et grande échelle. En effet, à la fin du mois d'août 2023, le Centre canadien pour la cybersécurité (CCCS) a sonné l'alarme, indiquant que les pirates informatiques s'attaquent tout particulièrement à l'éducation, à l'énergie, aux services publics et aux établissements de soins de santéNote de bas de page 3. Le CCCS a également prévenu que de nébuleux acteurs en ligne constitueront « très probablement une menace pour la sécurité nationale et la prospérité économique du Canada au cours des deux prochaines annéesNote de bas de page 4. »

En réaction, le gouvernement du Canada a souhaité renforcer ses propres moyens de cyberdéfense tout en cherchant à acquérir de nouvelles capacités offensives. Comme nous l'avons souligné dans des rapports précédents, la plupart des organismes et des entités chargés de la sécurité développent de manière significative leurs systèmes numériques et fondés sur les données. L'intelligence artificielle (IA) est également devenue une priorité croissante pour les gouvernements du monde entier, et le gouvernement du Canada ne fait pas exception. Notre rapport précédent a aussi abordé le lien entre la sécurité nationale et l'intelligence artificielle, ainsi que l'importance des garanties de transparence dans le contexte du déploiement à plus grande échelle de tels systèmes par les gouvernements et l'industrie. En outre, l'absence de telles garanties minera la confiance du public et la numérisation doit être conçue dans un souci d'ouverture.

1.1 Confiance du public et réponse du gouvernement

Selon le Baromètre de confiance Edelman 2023, le pourcentage moyen de confiance envers les ONG, les entreprises, les gouvernements et les médias est passé de 54 % en 2022 à 52 % en 2023Note de bas de page 5. En ce qui concerne la police et le Parlement fédéral, selon l'enquête de Statistique Canada de 2023, les Canadiens ont un niveau de confiance élevé à l'égard de la police (67 %), les communautés racialisées ont un niveau de confiance nettement inférieur, et le niveau de confiance général envers le Parlement est faible (36 %)Note de bas de page 6. Pour ce qui est des technologies émergentes telles que l'intelligence artificielle, une étude mondiale sur les niveaux de confiance à l'horizon 2023 menée par KPMG et l'université du Queensland a révélé que la plupart des citoyens sont divisés sur la question de savoir si les avantages escomptés l'emportent sur les risques probables, et que seulement 40 % des personnes interrogées dans l'ensemble des pays estiment que la réglementation, les lois et les mesures de protection actuelles sont suffisantes pour rendre l'utilisation de l'intelligence artificielle sûreNote de bas de page 7 . Une enquête d'Ipsos de 2022 sur la connaissance de l'intelligence artificielle et la confiance à son égard a révélé que les Canadiens sont plus sceptiques envers l'intelligence artificielle que la moyenne mondiale. Seul un tiers (34 %) des personnes interrogées ont déclaré faire autant confiance aux entreprises qui utilisent l'intelligence artificielle qu'aux autres entreprisesNote de bas de page 8.

À tout le moins, il est encourageant de constater que de nombreux gouvernements reconnaissent la nécessité d'adopter un état d'esprit plus ouvert en termes de cyberpréparation interne et de résilience numérique. À titre d'exemple, le 30 octobre 2023, le président Biden a signé un décret présidentiel sur la sûreté, la sécurité et la confiance en matière d'intelligence artificielleNote de bas de page 9. Il comprend des mesures visant à « garantir une utilisation responsable et efficace de l'intelligence artificielle par les pouvoirs publics. » Le Canada y est mentionné comme étant l'un des pays consultés par les États-Unis au sujet des cadres de gouvernance de l'intelligence artificielle. En ce qui concerne la nécessité spécifique de faire preuve de transparence par rapport à l'utilisation de la technologie par le gouvernement, le décret présidentiel signé le 12 mai 2021 sur l'amélioration de la cybersécurité de la nation souligne qu'« en fin de compte, la confiance que nous accordons à notre infrastructure numérique devrait être proportionnelle au degré de confiance et de transparence de cette infrastructure, et aux conséquences que nous subirons si cette confiance est mal placéeNote de bas de page 10. »

Le gouvernement du Canada a adopté ses propres outils internes, qui régissent le développement des applications d'intelligence artificielle. Ceux-ci incluent la Directive sur la prise de décisions automatisée du Secrétariat du Conseil du TrésorNote de bas de page 11, une série de politiques sur l'utilisation de l'intelligence artificielle qui s'inscrit dans le guide de l'utilisation de l'intelligence artificielle générativeNote de bas de page 12. Elle comprend l'outil d'évaluation de l'incidence algorithmique et aborde, entre autres, la nécessité de mettre en place des « mesures de transparence prévues pour la diffusion de l'information sur l'initiative à la clientèle et au publicNote de bas de page 13. » Étant donné que l'utilisation équitable et transparente de l'intelligence artificielle par le gouvernement ne peut être dissociée de son développement éthique au sein du secteur privé, le gouvernement du Canada a présenté en juin 2022 le projet de loi C-27, qui propose, entre autres modifications législatives, la Loi sur l'intelligence artificielle et les données. Ce projet de loi est toujours à l'étude à la Chambre des communes.

Malgré ces sentiments et ces initiatives louables, le gouvernement du Canada a également reconnu que les progrès réalisés étaient limités et que certains défis systémiques devaient être relevés – et qu'il restait encore beaucoup à faire. Alors que les gouvernements cherchent à renforcer leurs capacités numériques (de nombreuses entités telles que le Centre de la sécurité des télécommunications [CST], l'Agence des services frontaliers du Canada [ASFC] et la Gendarmerie royale du Canada [GRC] se sont explicitement engagées à le faire), ces efforts donnent lieu à d'importantes questions quant aux moyens et aux conséquences, voulues ou non, qui permettent d'établir l'efficacité et la responsabilité. Et c'est là que l'ouverture et la transparence revêtent une importance cruciale.

Outre les conséquences profondes en matière de protection des renseignements personnels (un thème clé de nos rapports précédents et du présent rapport), la numérisation et les processus gouvernementaux de plus en plus fondés sur les données posent des problèmes de transparence à bien des égards. En voici quelques exemples importants :

- Dissimulation : la transparence peut être entravée par le déploiement dissimulé d'outils numériques;

- Complexité : les technologies numériques et les configurations algorithmiques dépassent l'entendement de la plupart des citoyens et des intervenants;

- Inintelligibilité : de nombreuses technologies numériques, notamment les systèmes d'intelligence artificielle, reposent sur des éléments qui sont souvent inintelligibles, même pour de nombreux experts;

- Imprévisibilité : la technologie numérique, notamment l'utilisation de l'intelligence artificielle dans des systèmes décisionnels automatisés, produit souvent des conséquences imprévues, ce qui vient compliquer davantage les questions de la transparence et de la responsabilité.

1.2 Ouverture envers la numérisation

Lorsqu'il est question de relever ces défis, tout en cherchant à reconnaître les possibilités d'importance essentielle offertes par l'innovation numérique et fondée sur les données, l'enjeu de la transparence est important. Il doit être considéré comme central dans la mise en œuvre de réformes de la gouvernance numérique et de la sécurité nationale. Les nouveaux partenariats internes et externes demandés par les gouvernements eux-mêmes exigent un engagement en faveur de l'ouverture systémique et de la mobilisation publique afin d'inverser l'érosion de la confiance qui peut grandement entraver les capacités d'innovation et d'adaptation des gouvernements, en particulier compte tenu de l'accélération du rythme de l'évolution technologique.

L'ouverture et la mobilisation sont également essentielles à l'atténuation des possibles préjugés inhérents aux systèmes numériques qui comportent des risques accrus pour les communautés les plus vulnérables et stigmatisées (un thème clé de notre rapport précédent). Un effectif diversifié et inclusif est également un moteur essentiel d'innovation numérique au sein du secteur public, comme l'ont reconnu les organismes chargés de la sécurité nationale du Canada, qui peinent pourtant à cet égard.

Sur la base de cette première section d'introduction, le présent rapport est organisé de la manière suivante :

- la deuxième partie vise à expliquer certains risques, certains défis et certaines possibilités clés issus de l'expansion du paysage numérique dans le domaine de la sécurité nationale. Il convient de noter d'emblée que cette section ne présente qu'un échantillon des risques, des défis et des possibilités; elle n'est pas exhaustive sur le plan de l'étendue ou de la profondeur;

- la troisième partie propose des recommandations spécifiques que les organismes chargés de la sécurité nationale devraient envisager d'adopter. Celles-ci concernent les principes de gouvernance et les mesures de protection permettant d'équilibrer l'innovation numérique et la responsabilité publique à l'avenir.

Nos recommandations sont formulées en tenant compte des principes de transparence du gouvernement du Canada, qui ont été élaborés pour étayer l'Engagement de transparence en matière de sécurité nationaleNote de bas de page 14. Nous espérons donc que les discussions et les orientations contenues dans le présent rapport contribueront à renforcer l'état de préparation du gouvernement en matière de sécurité nationale et ses qualités numériques en exploitant mieux la transparence à titre de base de l'innovation continue, de la responsabilisation systémique et de la confiance du public.

2. La sécurité nationale et l'expansion du paysage numérique

La signification du mot « transparence » diffère d'une personne à l'autre. Comme nous l'avons expliqué dans notre deuxième rapport, publié en novembre 2021, la transparence peut être définie de manière étroite et passive, et correspondre à la décision du gouvernement de divulguer ou non certains renseignements ou certaines données. Dans ce rapport, nous avons vivement encouragé les institutions de sécurité nationale et de renseignement à rejeter une telle approche. Nous avons plutôt recommandé l'adoption d'une approche plus large et plus proactive, fondée sur la reconnaissance de l'importance des échanges entre le gouvernement et les Canadiens. Selon ce point de vue, les institutions de sécurité nationale et de renseignement ont à la fois la responsabilité d'être ouvertes et un intérêt à l'être. Dans le cadre d'une telle approche, l'ouverture va au-delà du flux unidirectionnel de l'information et des données et inclut une mobilisation marquée par un dialogue continu (plutôt qu'uniquement en période de crise), dynamique (plutôt qu'unidirectionnel) et complet avec les Canadiens.

Cette section porte sur le croisement entre la sécurité nationale et le paysage numérique dynamique en pleine expansion. Comme indiqué dans la section précédente, cette discussion n'est pas exhaustive. Elle propose plutôt un aperçu et un échantillon des risques, des défis et des possibilités de notre époque auxquels le milieu de la sécurité nationale est confronté du fait de la technologie numérique. La rapidité de l'évolution, associée à de longues et complexes histoires, rend difficile d'établir une vue d'ensemble plus détaillée. De même, des limites pratiques, notamment le temps dont dispose le GCT-SN pour procéder à la collecte de données pour chaque rapport, rendent encore plus complexe une étude plus large et plus approfondie. Cela dit, le GCT-SN a recueilli les commentaires d'un certain nombre de membres de la communauté représentant les médias, le milieu de la sécurité nationale, le milieu universitaire, la société civile et le secteur privé (voir l'annexe). Un certain nombre de thèmes en sont ressortis. Ils correspondent aux sous-sections suivantes :

- 2.1. Cybersécurité et protection des renseignements personnels;

- 2.2. Sécurité et haine en ligne, et extrémisme violent à caractère idéologique;

- 2.3. Intelligence artificielle;

- 2.4. Surveillance et chiffrement;

- 2.5. Équité, diversité et inclusion.

Chaque thème est examiné tour à tour et constitue la base des recommandations formulées dans la troisième section.

2.1 Cybersécurité et protection des renseignements personnels

La dépendance croissante du monde envers les infrastructures numériques fait de la cybersécurité une préoccupation croissante dans l'ensemble des secteurs. Les cyberattaques deviennent des problèmes de sécurité nationale lorsqu'elles visent nos infrastructures essentielles. Le gouvernement du Canada doit relever un double défi consistant à garantir la mise en place de cyberdéfenses sans porter atteinte à la protection des renseignements personnels dans le cyberespace. Le développement des cybercapacités offensives qui se présentent de plus en plus sous la forme d'outils de sécurité nationale et d'opérations de renseignement qui obligent souvent les autorités canadiennes et leurs alliés à faire face à des menaces extérieures communes fait croître les risques pour la protection des renseignements personnels.

En ce qui concerne la gouvernance de la cybersécurité et l'importance de la transparence lorsqu'il s'agit de relever certains des principaux défis et de saisir les possibilités qui se présentent au secteur public, trois sous-thèmes spécifiques seront examinés ici : i) l'infrastructure numérique et les capacités en matière de données; ii) la collaboration et la mobilisation externes pour acquérir une résilience collective dans l'ensemble des secteurs; et iii) l'ingérence électorale et la stabilité démocratique.

A) Complexité de l'infrastructure numérique et transparence

L'Engagement de transparence en matière de sécurité nationale du gouvernement du Canada vise une plus grande ouverture quant au fonctionnement et aux conséquences de l'appareil de sécurité nationale, qui dépend de plus en plus de la technologie numérique et des capacités sans cesse croissantes de collecte et d'analyse de données. Au sein d'une telle communauté organisationnelle et stratégique dont le fonctionnement se veut traditionnellement insulaire et secret, la complexité de l'infrastructure numérique, qui ajoute à l'inintelligibilité des opérations de sécurité nationale, peut renforcer ces tendances et paralyser encore davantage le contrôle, la responsabilité, l'apprentissage et l'innovation.

En revanche, la transparence systémique peut être un important moteur pour la confiance indispensable aux fonctionnaires qui dépendent de cette infrastructure et aux intervenants et citoyens touchés par son fonctionnement et son utilisation.

La question complexe qui se pose alors est la suivante : comment s'assurer au mieux que l'infrastructure numérique est à la fois fiable et transparente? L'un des principaux défis à relever consiste à trouver un juste équilibre entre d'une part les solutions et les outils propriétaires, c'est-à-dire l'infrastructure numérique dont le code est soigneusement protégé, et d'autre part les principes et les solutions à source ouverte. Alors que les gouvernements cherchent à développer à l'interne des cyberdéfenses de plus en plus spécialisées, le risque lié à une dépendance excessive à l'égard de fournisseurs externes dont les méthodes et la propriété intellectuelle sont protégées est de limiter la compréhension collective et la capacité d'adaptation au sein du gouvernement, tout en protégeant davantage les mécanismes de contrôle et d'examen. Pour faire face à ce risque, la Cybersecurity and Infrastructure Security Agency (CISA) des États-Unis a élaboré une « feuille de route pour la sécurité des logiciels à source ouverte » qui explique comment l'Agence assurera une utilisation sécurisée des logiciels à source ouverte au sein du gouvernement fédéral et appuiera un écosystème mondial de logiciels à source ouverte sain, sûr et durableNote de bas de page 15. Du point de vue de la transparence, il s'agit d'une avancée notable.

Si les logiciels à source ouverte peuvent contribuer à améliorer la transparence, la responsabilité doit tout de même être considérée avec soin. L'industrie du logiciel pourrait toujours profiter de la possibilité de migration vers l'infonuagique pour se décharger de toute responsabilité par le biais de clauses contractuelles de non-responsabilité complexes.

La protection des renseignements personnels est un autre défi important, croissant et étroitement lié à la numérisation de la sécurité nationale. Alors que les autorités chargées de la sécurité nationale cherchent à recueillir, analyser et éventuellement partager des données personnelles provenant d'une multitude de sources internes et en ligne, l'inintelligibilité de ces processus doit être un sujet de préoccupation. La publication de protocoles et de lignes directrices concernant l'utilisation des données et la protection des renseignements personnels est un aspect essentiel de l'ouverture et de la responsabilité. Les efforts actuels de l'ASFC visant à faciliter la mise en place de mécanismes de passage frontalier et de protection des frontières plus harmonieux et numérisés en sont un exemple. Le GCT-SN a eu le plaisir de collaborer avec l'Agence des services frontaliers du Canada dans ses efforts de mobilisation proactive des intervenants quant aux questions d'utilisation et de protection des données.

Le Canada n'est pas le seul à numériser le contrôle aux frontières; Singapour a récemment annoncé son intention de remplacer les passeports par des données biométriques afin d'automatiser davantage les formalités d'immigration sans passeport. Comme l'explique un article de CNN : « un jeton d'authentification unique sera généré à l'aide des données biométriques et sera utilisé à différents points de contact automatisés – du comptoir de dépôt de bagages au passage à l'immigration et à l'embarquement – éliminant ainsi la nécessité d'avoir en main des documents de voyage physiques tels que les cartes d'embarquement et les passeportsNote de bas de page 16. »

Ces avancées technologiques soulignent l'urgence de moderniser les obligations du secteur public en matière de protection des renseignements personnels. Nous nous joignons au Commissariat à la protection de la vie privée du Canada (CPVP) pour soutenir la proposition du ministère de la Justice consistant à moderniser la Loi sur la protection des renseignements personnels, notamment en introduisant l'obligation de tenir un registre des atteintes à la vie privée, de les déclarer au CPVP et d'aviser les personnes de toute atteinte à la vie privée qui présente un risque réel de préjudice grave à l'endroit d'un individu, comme c'est déjà le cas dans le secteur privé.

À mesure que ces services innovants se développent, les défis en matière de transparence et de confiance liés aux fondements cybernétiques de l'infrastructure numérique prennent de l'importance et deviennent plus complexes. Les objectifs stratégiques, les mécanismes de gouvernance et l'état de préparation au numérique doivent tous être conformes et faire l'objet d'un examen et d'une adaptation continus.

B) Collaboration transparente avec le secteur privé

Alors que les gouvernements s'efforcent de trouver un équilibre entre les questions d'ouverture, de complexité et de secret au sein de leurs propres organisations, il est également dans l'intérêt du public de déterminer le niveau approprié de transparence qui devrait s'appliquer au fonctionnement du secteur privé. Qu'il s'agisse des services financiers, de la vente au détail, des voyages, des divertissements ou des services médicaux, la cybersécurité est de plus en plus présente dans la vie de tous les jours, ce qui donne lieu à une augmentation des risques due à une préparation et à des défenses insuffisantes, ainsi qu'à des menaces plus malveillantes. Le CCCS a souligné que ces défis ne concernent pas seulement les organisations individuelles, mais constituent également des menaces pour l'ensemble de la sécurité nationale en raison des interdépendances entre les systèmes et les secteurs, et de l'instabilité qui peut en résulter.

En s'appuyant sur la Stratégie nationale de cybersécurité de 2018, le gouvernement du Canada a récemment présenté le projet de loi C-26, Loi concernant la cybersécurité, modifiant la Loi sur les télécommunications et apportant des modifications corrélatives à d'autres lois, qui vise à répondre à ces préoccupations en établissant un cadre afin de « mieux protéger les systèmes qui sont vitaux pour la sécurité nationale et offrir aux autorités de nouveaux outils pour répondre aux dangers émergents dans le cyberespaceNote de bas de page 17. » Cette nouvelle loi permettrait ainsi au gouvernement de réglementer les entreprises privées (en particulier celles de secteurs clés, notamment des banques et des télécommunications) et de procéder à des vérifications auprès de celles-ci en ce qui a trait à leurs pratiques et réponses en matière de cybersécurité, et même, dans certains cas, d'imposer des sanctions pénales en cas de non-conformité.

Le projet de loi a suscité un débat important en ce qui concerne la transparence, le contrôle et l'examen. Un rapport du Citizen's Lab de l'université de Toronto s'est montré particulièrement critique à l'égard des limites de la législation en ce qui concerne ces éléments, appelant à des réformes significatives avant l'adoption du projet de loiNote de bas de page 18. Pour trouver un équilibre entre la sécurité nationale et les principes démocratiques, le rapport recommande notamment au gouvernement de « préciser les rôles du commissaire fédéral à la protection de la vie privée, du Comité des parlementaires sur la sécurité nationale et le renseignement et de l'Office de surveillance des activités en matière de sécurité nationale et de renseignement aux différents stades du processus d'élaboration des ordonnances ou des règlementsNote de bas de page 19. »

Bien que nous reconnaissions la complexité des questions en jeu, nous sommes d'avis que des mesures et des mécanismes plus enracinés en matière d'ouverture et de contrôle sont indispensables. Nous notons également qu'une telle approche est conforme aux efforts déployés par le gouvernement visant à être plus transparent en ce qui a trait au développement et au déploiement des systèmes d'intelligence artificielle, un sous-thème sur lequel nous reviendrons plus loin dans le présent rapport.

Nous notons également que l'élargissement et le renforcement des formes de collaboration avec le secteur privé constituent une dimension essentielle de la cyberpréparation pour l'ensemble du pays et sont reconnus comme tels dans la Stratégie nationale de cybersécurité de 2018 du gouvernement et par le CCCS dans son récent rapport de 2023 sur l'aggravation des cybermenaces. Un examen interne de la stratégie de 2019 réalisé par Sécurité publique Canada a révélé que ces relations ont connu une évolution lente et qu'une plus grande collaboration est nécessaire à l'avenir. Il est donc essentiel pour l'apprentissage et la responsabilité, parallèlement aux mesures spécifiques du projet de loi C-26 qui pourraient éventuellement être mises en œuvre, de garantir un certain degré de transparence en ce qui concerne l'objectif et le fonctionnement de ces relations de collaboration.

C) Ingérence électorale et intégrité démocratique

Face aux préoccupations croissantes concernant l'ingérence électorale d'entités étrangères, l'enquête publique en cours sur ces questions constituera une occasion importante d'examiner cette question en profondeur. Comme l'ont clairement indiqué le CCCS et l'ancien gouverneur général David Johnston dans son étude portant sur l'ingérence électorale, ces menaces et préoccupations comportent d'importantes dimensions « cybernétiques » qu'il convient de comprendre et d'examiner à fond. La cyberattaque sophistiquée menée par la Russie contre l'administration centrale de l'Agence mondiale antidopage (AMA) à Montréal et son partenaire canadien, le Centre canadien pour l'éthique, les mêmes éléments du GRU (service russe du renseignement militaire) qui se sont immiscés dans les élections américaines en utilisant des tactiques semblables et l'affaire récente concernant une campagne de désinformation par « Spamouflage » visant les législateurs canadiens, prétendument menée par la Chine, appuient leurs recommandations.

Le rapport du comité ETHI sur l'ingérence étrangère et les menaces entourant l'intégrité des institutions démocratiques, de la propriété intellectuelle et de l'État canadienNote de bas de page 20 comprend plusieurs recommandations visant directement à améliorer la transparence des opérations de sécurité nationale. La recommandation no 3 est peut-être la plus pertinente pour le mandat du GCT-SN : que le gouvernement du Canada demande un partage accru et régulier d'information pertinente au public par le Service canadien du renseignement de sécurité (SCRS) afin d'augmenter la littéracie en matière de sécurité nationaleNote de bas de page 21. Nous avons constaté que le SCRS et le CST renseignaient activement les Canadiens sur les menaces d'ingérence étrangère, y compris les risques pour les institutions démocratiques bien avant l'attention récente portée à l'ingérence étrangère, bien que la désignation de certains pays tels que la Chine soit récente (2020 dans la version non expurgée du rapport annuel 2019 du Comité des parlementaires sur la sécurité nationale et le renseignement). Si l'intention de la recommandation no 3 est d'inviter à communiquer des détails plus précis sur la nature de la menace, nous notons que de nombreux témoins experts qui ont comparu pour parler de ce sujet ont décrit les limites de la loi actuelle sur le SCRS.

De plus, nous recommandons vivement d'intégrer de manière active et cohérente les résultats des activités de mobilisation dans les processus d'élaboration des politiques et les processus opérationnels. Les communautés racialisées ont souvent l'impression que la mobilisation est largement considérée comme un exercice de « case à cocher » au sein des institutions de sécurité nationale, et que les rapports se basant sur les conversations qui ont eu lieu dans le cadre de ces activités sont par la suite mis au rancart. Il incombe ici aux institutions de sécurité nationale de faire preuve de transparence et de convaincre les intervenants que ce n'est pas le cas.

Certains intervenants ont fait part au GCT-SN d'une préoccupation concernant les efforts passés visant à garantir l'état de préparation démocratique pendant les élections, soit le caractère relativement secret du mécanisme interne d'examen de ces menaces pendant les périodes électorales. L'approche déployée jusqu'à présent consiste en un petit groupe de quatre ou cinq hauts fonctionnaires chargés d'assurer le suivi de l'évolution de la situation et de déterminer toute mesure d'intervention appropriée (y compris tout appel public). Leurs efforts sont orientés par le protocole public en cas d'incident électoral majeur et, à la suite de l'élection de 2021, un examen indépendant a été préparé par un ancien sous-ministre (Morris Rosenberg) et les conclusions ont été rendues publiquesNote de bas de page 22. Il s'agit d'un élément d'un plan intégré visant à renforcer le système électoral canadien contre les cybermenaces et autres menaces. Bien que le mécanisme ait été conçu pour garantir que le comité indépendant n'interviendrait pas à moins que la nature de l'ingérence étrangère ne soit telle qu'il serait dans l'intérêt du public d'en être informé, des questions ont été soulevées concernant le seuil de partage et à savoir s'il est actuellement trop élevé.

Comme l'a clairement mis en évidence l'examen par David Johnston concernant les allégations d'ingérence électorale de la Chine, il existe d'importantes distinctions entre les formes analogiques et numériques des menaces en jeu qu'il faut bien comprendre. Pourtant, les menaces numériques se multiplient, tant au Canada que dans les démocraties du monde entier. L'International Cyber Policy de l'Australian Strategic Policy Institute (ASPI) a recensé 41 élections et sept référendums de janvier 2010 à octobre 2020 susceptibles d'avoir fait l'objet de cyberactivités d'ingérence étrangère sous la forme de cyberopérations, d'opérations d'information en ligne ou d'une combinaison de ces deux types d'opérations. L'ASPI décrit plus en détail cet ensemble croissant de menaces et le rôle central des médias sociaux à titre de vecteur d'ingérence électorale :

[Traduction] La prolifération des acteurs participant aux élections et la numérisation des fonctions électorales ont considérablement élargi la surface d'attaque que peuvent viser les acteurs étatiques étrangers. Cette évolution a été en grande partie facilitée par la croissance omniprésente et persistante des médias sociaux et des plates-formes de réseautage, qui ont rendu les populations ciblées plus accessibles que jamais aux acteurs étatiques étrangersNote de bas de page 23.

Le renforcement de la transparence devra être considéré comme une occasion essentielle de sensibiliser davantage le public et de mobiliser davantage les intervenants dans le cadre de la révision continue des institutions démocratiques pour les adapter aux nouveaux environnements numériques. Le rapport Rosenberg formule de nombreuses recommandations utiles visant à accroître l'ouverture et la mobilisation des intervenants dans cet esprit. La recommandation no 14 en est un exemple important. Elle porte sur l'amélioration de la sensibilisation politique et de la connaissance en matière de technologie numérique des élus par le biais des organismes chargés de la sécurité nationale et d'efforts de sensibilisation : « Les organismes de sécurité nationale devraient élaborer un programme de séances d'information non classifiées pour sensibiliser les députés et les sénateurs à l'ingérence étrangère et à l'ingérence dans les élections, ainsi qu'aux mesures qu'ils peuvent prendre pour se protéger et protéger leurs informations en ligneNote de bas de page 24. »

Comme l'indique clairement le rapport, la cybersécurité et l'intégrité électorale sont également des éléments interdépendants de préoccupations plus vastes concernant le déroulement démocratique des élections dans un monde de plus en plus branché. Ces préoccupations influencent également le discours démocratique et la participation entre les élections. La désinformation et la haine en ligne provenant de sources nationales et étrangères sont de plus en plus répandues et ont un impact croissant. C'est pourquoi nous nous intéressons à présent à ces préoccupations et à nos propres observations dans ce domaine.

2.2 Sécurité et haine en ligne, et extrémisme violent à caractère idéologique

Si les médias sociaux et les autres plates-formes en ligne offrent une multitude de possibilités en éliminant les obstacles de l'échelle, de l'espace et du temps pour permettre aux gens de se retrouver, d'acquérir et de diffuser des connaissances et de coopérer à des causes communes, ces possibilités peuvent être éclipsées par la désinformation, des efforts visant à radicaliser et à recruter des personnes vulnérables à l'aide de visions du monde idéologiques ou religieuses poussées à l'extrême, voire l'incitation à la violence au sein de groupes ou chez des acteurs isolés.

Ces comportements indésirables ne sont pas tous pris en compte par les cadres juridiques actuels. En effet, le concept de « sécurité en ligne » englobe souvent des questions qui se situent en marge de la cybersécurité traditionnelle ou qui lui sont totalement étrangères. Il est également utilisé pour indiquer que de nombreux domaines où surviennent des problèmes de sécurité ou de vulnérabilité échappent à la plupart des types de réglementation explicite. Au minimum, la sécurité est simplement une question de sensibilisation personnelle et de circonspection lors de la navigation et des interactions en ligne.

A) La transparence dans la réponse du gouvernement du Canada

Même les infractions clairement définies telles que le discours haineux, les menaces et le harcèlement se sont révélées difficiles à prévenir ou à sanctionner. Nombre de comportements évoqués dans les discussions sur la sécurité en ligne ne répondent souvent pas aux normes requises pour faire l'objet de poursuites pénales. Pourtant, au cours des dernières décennies, de nombreux citoyens, experts et groupes communautaires ont réclamé un contrôle et une réglementation accrus des comportements en ligne. Le gouvernement du Canada a donc tenté à plusieurs reprises de s'attaquer à ces enjeux. La Loi modifiant le Code criminel et la Loi canadienne sur les droits de la personne et apportant des modifications connexes à une autre loi (propagande haineuse, crimes haineux et discours haineux) (projet de loi C-36), qui est morte au Feuilleton lors de la dissolution du Parlement en 2021, porte sur les préjudices en ligneNote de bas de page 25. Elle visait à s'attaquer à des enjeux habituellement associés à la sécurité nationale, notamment le terrorisme, la propagande, l'ingérence dans les institutions démocratiques, et à mobiliser le SCRS et la GRC. Le SCRS devait être habilité à demander des renseignements sur les abonnés aux fournisseurs de services et de plates-formes, et un « commissaire à la sécurité numérique » spécial aurait eu le pouvoir d'exiger le retrait d'Internet de contenus et d'utilisateurs contrevenants. Toutefois, le projet de loi a été critiqué parce qu'il ne définissait pas clairement la limite entre préjudice et désagrément, entre haine et liberté d'expression, et parce qu'il chargeait des entités privées de maintenir l'ordre sur leurs plates-formes. Le projet de loi C-36 a rapidement fait ressortir la complexité de la sécurité en ligne lorsque l'on considère l'intersection des droits et idéologies contradictoires, où l'introduction d'exigences légales strictes, telles que celles incluses dans le projet de loi C-36, génère beaucoup plus de problèmes que de solutions.

Le fait que le gouvernement a gardé secrets tous les documents de consultation publique relatifs au projet de loi C-36, faisant preuve d'un manque total de transparence, est tout aussi important et notable aux fins du présent rapport et des travaux du GCT-SN. Les documents n'ont été divulgués qu'en réponse à une demande d'accès à l'information. Un bon résumé des points de vue exprimés lors des consultations a par la suite été fourni. Cela a démontré que s'il est assez facile de parvenir à un consensus sur l'adoption de nouvelles mesures pour protéger les enfants, il est beaucoup plus difficile de parvenir à un consensus sur les mesures nécessaires pour répondre à d'autres préoccupations.

Lors de la consultation ultérieure d'experts, visant à relancer le projet de loi, il est devenu évident qu'une part importante des comportements jugés préjudiciables par certains étaient protégés par la Charte canadienne des droits et libertés et qu'une intervention gouvernementale n'était peut-être pas justifiée. En bref, le gouvernement ne semble pas avoir trouvé une voie claire pour contrôler les comportements criminels en ligne. Les efforts continus qu'il déploie à cet égard doivent bénéficier de la sécurité et de la mobilisation du public. La transparence sera nécessaire à tous les stades du processus lors de toute éventuelle tentative de changement législatif.

B) Transparence de l'application de la loi

Si l'on part du principe que les discours haineux et la propagande extrémiste ou terroriste constituent des menaces réelles pour la sécurité nationale et font partie du mandat des organismes de sécurité nationale, la question de la transparence revêt une signification légèrement différente : assurer le contrôle de ce type de propagande, le cerner et agir pour y donner suite requière une certaine forme de surveillance sur Internet. La transparence est donc essentielle à la protection des droits de la personne dans le cadre de ces opérations de sécurité nationale. Un aspect préliminaire important de cette question est que les groupes extrémistes ne publient pas nécessairement des discours extrémistes (ils « assainissent » souvent délibérément leur visage public) et qu'en même temps, tout discours extrémiste n'indique pas nécessairement que ceux qui le prononcent sont de véritables extrémistes : les cas de propos malavisés, enthousiastes ou mal informés abondent. En d'autres termes, l'approche axée sur les « préjudices en ligne » pourrait plus facilement cibler ces individus moins dangereux, ce qui ne constituerait pas un moyen efficace de protéger la sécurité nationale.

Par le passé, le CST et le SCRS ont tous deux assuré une surveillance des actes de parole, jetant essentiellement leurs filets sur de soi-disant terroristes dits « djihadistes » ou « extrémistes islamistes », en partie en raison d'une conviction que de tels actes sont précurseurs d'activités illicites dans le monde physique. Depuis 2002, les rapports annuels du SCRS désignent toujours dans l'ensemble les réseaux islamistes internationaux comme la principale menace pour le Canada. À tel point que de nombreuses associations musulmanes et de défense des libertés civiles au Canada ont dénoncé cette attention exagérée et ses conséquences. Aujourd'hui, les nouvelles catégories, plus larges et plus vagues, que sont l'extrémisme violent à caractère idéologique (EVCI), l'extrémisme violent à motivation raciale (EVMR) et l'extrémisme violent à caractère politique (EVCP) peuvent donner lieu à des questions semblables, à beaucoup plus grande échelle. Les Canadiens voudront savoir :

- Quelle est l'étendue de la surveillance sur les plates-formes publiques, par quel organisme est-elle exercée, en vertu de quel ensemble de directives? Que fait-on des données, pendant combien de temps les différents types de données sont-ils conservés?

- Concrètement, comment cette surveillance permet-elle de cerner et d'atténuer

les menaces réelles?

- Les nouvelles catégories EVCI, EVMR et EVCP correspondent-elles réellement à des groupes et/ou à des individus objectivement réels, statistiquement significatifs et discrets (p. ex. où se situeraient l'islam politique ou les suprémacistes blancs chrétiens dans cette répartition, et est-il utile d'en décider)?

- Dans quelle mesure les activités en ligne de ces entités sont-elles répréhensibles et constituent donc de bonnes cibles pour le contrôle par le gouvernement?

- Étant donné que la plupart des discours surveillés se trouvent sur les médias sociaux et que les relations entre le gouvernement canadien et les exploitants de ces plates-formes sont actuellement très conflictuelles, de quelles façons spécifiques la coopération de ces derniers sera-t-elle assurée?

Nous encourageons les organismes chargés de la sécurité nationale à poursuivre et à élargir les efforts qu'ils ont déployés pour mieux décrire les menaces en ligne et les partenariats actifs avec des organisations indépendantes mieux placées pour contrer certaines de ces menaces. Comme toujours, ces descriptions doivent contenir des renseignements clairs et complets afin d'aider les citoyens à comprendre l'importance relative des différentes formes de menaces et de vulnérabilités. De simples listes de menaces possibles ou potentielles, ne comportant aucune indication quant à leur importance, probabilité ou fréquence, ne permettent pas d'atteindre cet objectif primordial. De plus, en raison de la nature fluide et dynamique de cet environnement, ces renseignements doivent être mis à jour régulièrement. Le gouvernement doit également mieux décrire aux Canadiens la nature de la menace en ligne dans les divers environnements, y compris ceux du Web clandestin, afin de justifier et de soutenir les instruments et outils mesurés susceptibles d'atténuer la menace sans compromettre nos valeurs démocratiques.

2.3 Intelligence artificielle

Dans son rapport de 2022, le GCT-SN a adopté une définition large du terme « intelligence artificielle », en se basant sur les lignes directrices de l'OCDE, qui inclut tout processus machine utilisé pour produire ou aider à produire des décisions organisationnelles ou individuelles. De tels processus sont actuellement utilisés dans la production de renseignements par de nombreux organismes liés à la sécurité nationale. Il peut s'agir de la surveillance d'énormes ensembles de données (surveillance individuelle, reconnaissance de formes, analyse de réseaux, analyse géographique), de l'identification et l'authentification d'individus et d'objets (reconnaissance biométrique et comportementale, scanneurs de colis et de bagages), de la prédiction spatio-temporelle se basant sur de multiples sources de données (maintien de l'ordre prédictif) ou de la désanonymisation de données et du rapprochement de bases de données (analyse de données provenant de sources ouvertes).

Depuis lors, la Loi édictant la Loi sur la protection de la vie privée des consommateurs, la Loi sur le Tribunal de la protection des renseignements personnels et des données et la Loi sur l'intelligence artificielle et les données et apportant des modifications corrélatives et connexes à d'autres lois (projet de loi C-27) a été déposée, introduisant la Loi sur l'intelligence artificielle et les données pour réglementer l'utilisation de l'intelligence artificielle dans le commerce et les échanges internationaux et interprovinciaux. Le projet de loi définit un système d'intelligence artificielle comme un « système technologique qui, de manière autonome ou partiellement autonome, traite des données liées à l'activité humaine par l'utilisation d'algorithmes génétiques, de réseaux neuronaux, d'apprentissage automatique ou d'autres techniques pour générer du contenu, faire des prédictions ou des recommandations ou prendre des décisionsNote de bas de page 26. »

Comme l'explique le troisième rapport de 2022 du GCT-SN (section 4 sur l'intelligence artificielle), il existe trois types de dommages qui peuvent découler de la conception et du déploiement des systèmes d'intelligence artificielle : les dommages intentionnels, les dommages involontaires et les dommages systémiques. Les dommages intentionnels peuvent être le reflet d'efforts militaristes, d'une série de cyberintrusions ou même d'exercices de collecte de renseignements ayant des objectifs perturbateurs ou offensifs. Les dommages involontaires reflètent souvent des défauts de conception algorithmique (souvent non prévus) qui peuvent avoir des effets pervers sur des individus ou des groupes d'individus; un exemple fréquemment cité est celui d'une institution financière qui déploie un programme d'intelligence artificielle qui exclut par inadvertance davantage d'individus appartenant à une minorité racialisée. Les dommages systémiques sont souvent étroitement liés aux dommages involontaires, mais l'échelle est souvent plus générale et les problèmes plus profondément enracinés et difficiles à rectifier. Il est important de reconnaître ces trois types de dommages dans le cadre de la dépendance croissante du milieu de la sécurité nationale à l'égard des systèmes d'intelligence artificielle dans ses divers programmes et services (en gardant à l'esprit les objectifs en matière de sécurité et de service). La transparence de l'intelligence artificielle pose un nouveau défi discret pour les opérations de sécurité nationale en matière de transparence et de responsabilité.

Dans le contexte de l'accent plus large et plus direct mis dans le présent rapport sur la numérisation, nous nous attachons ici à mieux comprendre les nouvelles frontières entre sécurité nationale et intelligence artificielle, ainsi que certaines des principales tensions entre la transparence et le secret qui façonnent cette évolution. Nous examinons ensuite ces tensions et les situons par rapport aux réponses spécifiques du gouvernement du Canada – y compris les entités de sécurité nationale actuelles et les politiques et mécanismes proposés en cours d'élaboration.

A) Sécurité nationale et intelligence artificielle

En ce qui concerne les capacités des gouvernements à répondre aux défis en matière de sécurité nationale, l'utilisation de l'intelligence artificielle dans ce domaine est justifiée par deux moteurs fondamentaux : la pénurie de compétences humaines d'une part, et l'amélioration des performances de l'intelligence artificielle grâce à l'automatisation des processus, l'analyse des schémas et l'apprentissage et l'innovation guidés sur les données, d'autre part. Ces derniers éléments sont incontestablement nécessaires dans un monde où les menaces pour la sécurité nationale sont passées d'États hostiles clairs et avoués à des acteurs individuels dispersés et cachés.

De manière générale, les organismes chargés de la sécurité publique et nationale utilisent de plus en plus des solutions d'intelligence artificielle pour analyser un volume sans précédent de données non structurées, qu'il s'agisse de textes, d'images ou de données sur la mobilisation, et pour améliorer la reconnaissance des formes et des images ainsi que l'interprétation des tendances et des comportements. Par exemple, les caméras de télévision en circuit fermé (CCTV) utilisant l'intelligence artificielle peuvent aller au-delà de la capture d'images et relever les activités anormales et les comportements suspects.

En ce qui concerne la cybersécurité, selon le Centre canadien pour la cybersécurité (CCCS) du gouvernement fédéral, « l'intelligence artificielle fait appel à l'automatisation pour détecter les nouvelles menaces qui pèsent sur les organisations. Grâce à des algorithmes sophistiqués, l'intelligence artificielle peut automatiser la détection des menaces, comme les maliciels, procéder à la reconnaissance des schémas pour déterminer les liens entre les différents vecteurs d'attaque et fournir des renseignements prédicatifs supérieursNote de bas de page 27. » Lors d'une entrevue accordée aux médias en 2023, le dirigeant principal du CCCS a confirmé que l'intelligence artificielle est utilisée « dans des courriels d'hameçonnage, ou pour produire des courriels plus ciblés, dans des codes malveillants [et] dans la désinformation et la mésinformationNote de bas de page 28. »

Le développement et le déploiement de systèmes d'intelligence artificielle par d'autres entités entraîne également d'autres risques en matière de cybersécurité, qui s'ajoutent aux menaces malveillantes croissantes émanant d'acteurs hostiles, étatiques ou non étatiques (une réalité soulignée par le CCCS dans son rapport d'août 2023). Selon un expert américain : « Les experts en sécurité ont noté que les courriels d'hameçonnage générés par l'intelligence artificielle présentent un taux d'ouverture plus élevé que les courriels d'hameçonnage créés manuellement [par exemple] en incitant les victimes potentielles à cliquer sur ces courriels qui génèrent ainsi des attaques. […] L'intelligence artificielle peut également être utilisée pour concevoir des logiciels malveillants qui évoluent constamment, afin d'éviter la détection par les outils de défense automatisésNote de bas de page 29. »

Toutefois, l'étendue réelle de l'utilisation de l'intelligence artificielle dans divers contextes de sécurité nationale n'est pas connue. Il ne s'agit pas nécessairement d'un manque typique de transparence, car souvent les organisations elles-mêmes ne sont pas entièrement au fait des outils d'intelligence artificielle utilisés par leurs membres, en particulier en raison de la souplesse de la catégorie. Par exemple, nous ne savons pas si les fonctionnaires utilisent des outils tels que ChatGPT ou d'autres outils d'intelligence artificielle générative automatisée (y compris des outils de génération d'images). Le gouvernement fédéral a récemment publié des lignes directrices sur l'utilisation de l'intelligence artificielle générative dans ses activités. Il sera intéressant de voir dans quelle mesure elles seront appliquées au cours des mois à venir; toutefois, ces données pourraient être difficiles à recueillir, étant donné que l'application des lignes directrices est facultative.

Au fur et à mesure que ces types de défis se multiplient, les tensions entre la transparence et le secret s'intensifieront probablement en raison d'une combinaison de complexité technologique (due notamment aux éléments à source ouverte et de nature exclusive), de cadres juridiques et politiques régissant les efforts de sécurité nationale (qui font souvent écran à la transparence), et de nouvelles formes plus proactives d'ouverture et de mobilisation recherchées par les gouvernements à divers degrés. Nous examinons donc les défis en matière de transparence propres à l'intelligence artificielle et, plus loin, nous étudions certains des contours changeants des réponses du gouvernement du Canada – avant de formuler des recommandations spécifiques en vue d'accroître l'ouverture dans la troisième section du présent rapport.

B) Défis

Les raisons pour lesquelles il est essentiel de contrôler et de surveiller étroitement les outils décisionnels automatisés sont devenues évidentes lorsque nous avons consulté des experts en intelligence artificielle. Premièrement, comme nous l'avons indiqué dans notre rapport de 2022, les applications d'intelligence artificielle peuvent être biaisées parce qu'elles ont été entraînées à l'aide de données biaisées ou qu'on leur a fourni des données biaisées. Sachant, par exemple, que les données des services de police sont le produit d'organisations aux prises avec des problèmes de discrimination systémique, il apparaît probable que les résultats décisionnels automatisés seront tout aussi biaisés. Qui plus est, au fil du temps, ces résultats sont intégrés aux données analytiques, s'additionnent et croissent à un rythme accéléré s'ils ne sont pas contrôlés. Deuxièmement, les processus décisionnels faisant appel à l'intelligence artificielle sont presque toujours opaques, en partie parce qu'ils contiennent des secrets industriels des entreprises qui les commercialisent. Mais en réalité, l'opacité est une propriété inévitable de tous les processus avancés d'intelligence artificielle, en particulier de ceux fondés sur des modèles d'apprentissage profond. Comme l'ont souligné nos experts, leur complexité et leur pouvoir analytique sont proportionnels à leur opacité, à tel point que même leurs créateurs ne peuvent plus comprendre le lien entre les produits analytiques et les données d'entrée.

i) La transparence, un défi majeur pour l'intelligence artificielle

En ce qui concerne l'utilisation de l'intelligence artificielle par les organismes chargés de la sécurité nationale, la transparence entre en jeu principalement de deux manières : renseigner la population canadienne sur l'utilisation de l'intelligence artificielle à des fins de sécurité nationale et garantir la transparence algorithmique afin de maintenir l'« explicabilité » du fonctionnement interne de l'intelligence artificielle. Bien que le principe de transparence des gouvernements, en ce qui a trait à la responsabilité, soit établi depuis longtemps, il est soumis à un défi sans précédent lié à l'intelligence artificielle : l'opacité des algorithmes et des modèles d'apprentissage automatique, que l'on appelle désormais la « boîte noire ». L'utilisation de l'intelligence artificielle et de ses données de sortie à des fins de sécurité nationale pourrait devenir inexplicable si les organismes chargés de la sécurité nationale eux-mêmes en arrivent à perdre toute visibilité des processus de leurs propres applications d'intelligence artificielle.

Le rapport intérimaire du Comité de la science, de l'innovation et de la technologie du Parlement britannique (comité britannique) désigne l'effet « boîte noire » comme l'un des « douze défis posés par la gouvernance de l'intelligence artificielle ». Il cite la société à responsabilité limitée Burges Salmon qui a déclaré que « le défi est encore compliqué par le fait que plus l'outil d'intelligence artificielle est performant, moins il est susceptible d'être explicableNote de bas de page 30. » Essentiellement, pour produire des renseignements, l'apprentissage automatique fait des associations qui dépassent les capacités humaines. Plus la machine apprend, plus ces associations deviennent impénétrables pour l'humain.

L'effet « boîte noire » a en fait donné naissance à une nouvelle discipline, la « recherche sur l'explicabilité ». Malheureusement, elle accuse un retard important par rapport au développement de l'intelligence artificielle, d'une part parce que pour expliquer, il faut que le produit existe, et d'autre part parce que les budgets sont en comparaison microscopiques. De plus, ce type de recherche pourrait très probablement produire des comptes rendus de processus qui ne peuvent être compris que par des informaticiens et qui sont axés sur un ensemble d'objectifs différents de ceux qui sont habituellement associés à la gouvernance et au contrôle. Par exemple, les informaticiens s'intéresseront à la manière dont certains algorithmes sont optimisés à des fins de traitement efficace, tandis que les responsables de la surveillance civile voudront savoir quelle variable de données a été utilisée, pourquoi et avec quelle pondération.

ii) L'effet cumulatif du manque de transparence

Les défis en matière de transparence s'ajoutent à trois autres risques cernés par le comité britannique : les biais, car l'intelligence artificielle associe des données compilées par des humains, eux-mêmes biaisés, ce qui peut aggraver la discrimination; les atteintes à la protection des renseignements personnels dues à la capacité sans précédent de collecte et de génération de données personnelles, à l'insu de l'individu ou sans son consentement; et les fausses déclarations, c'est-à-dire la création de fausses données, de façon malveillante, en manipulant des individus, ou accidentelle, en saisissant des données erronées ou des « hallucinations en matière d'intelligence artificielle », c'est-à-dire le déraillement des systèmes d'intelligence artificielle au moyen de fausses associations.

Deux autres aspects doivent être pris en compte. Premièrement, les applications actuelles d'intelligence artificielle sont reconnues pour de courantes fuites de données d'entrée, ce qui constitue clairement un problème de sécurité nationale. Deuxièmement, nous devrons bientôt envisager la possibilité que des intelligences artificielles entièrement malveillantes soient introduites dans divers systèmes. Dans le contexte de la sécurité nationale, on entend par intelligence artificielle malveillante tout processus automatisé qui produit des résultats détournés (c.-à-d. profitant à un tiers), perturbateurs ou autrement dommageables, contre la volonté de l'utilisateur immédiat ou à son insu. Comme d'autres applications, elle peut se cacher dans les systèmes ou se présenter comme un outil légitime ou une partie d'un outil légitime. Le premier cas relève du paradigme de la cybersécurité, mais le second est clairement une question de gestion organisationnelle et de surveillance des utilisations de l'intelligence artificielle. Et compte tenu du problème de la « boîte noire » évoqué plus haut, cela s'annonce comme un défi.

iii) Réponses du gouvernement du Canada et initiatives proposées

Comme indiqué dans notre rapport de 2022, le gouvernement du Canada a cherché à faire de la transparence un élément central de ses activités de développement, de déploiement et de gouvernance de l'intelligence artificielle. Cinq principes fondamentaux ont été adoptés en vue d'une telle ouverture :

- comprendre et mesurer l'incidence de l'utilisation de l'intelligence artificielle en concevant et en diffusant des outils et des façons de faire;

- faire preuve de transparence quant à la façon et au moment d'utiliser l'intelligence artificielle, en se fondant sur un besoin clair des utilisateurs et l'intérêt du public;

- fournir des explications claires sur le processus décisionnel en matière d'intelligence artificielle tout en offrant des occasions d'examiner les résultats et de remettre en question les décisions;

- être le plus ouvert possible en communiquant le code source, les données sur la formation et d'autres renseignements pertinents, et ce, en protégeant les renseignements personnels, l'intégrité du système, ainsi que la sécurité et la défense nationales;

- offrir une formation adéquate pour que les employés du gouvernement qui conçoivent et utilisent des solutions liées à l'intelligence artificielle aient les compétences nécessaires en matière de conception, de fonctionnement et de mise en œuvre responsables pour améliorer les services gouvernementaux fondés sur l'intelligence artificielleNote de bas de page 31.

En se basant sur ces principes, le gouvernement a élaboré des outils et présenté un projet de loi, soit le projet de loi C-27 mentionné plus haut, et des organismes individuels ont adopté des initiatives.

Le cadre d'évaluation de l'incidence algorithmique du gouvernement du Canada a également fourni des outils importants à des fins d'évaluation interne et de contrôle externe de l'utilisation et de l'incidence de l'intelligence artificielle. Notre rapport de 2022 a également approuvé deux recommandations clés issues d'un récent rapport publié conjointement par les commissaires à l'information et à la protection de la vie privée de la Colombie-Britannique et du Yukon, qui examinent les répercussions de l'intelligence artificielle sur l'utilisation et les services gouvernementaux :

- La nécessité pour les organismes publics de s'engager à respecter des principes directeurs pour l'utilisation de l'intelligence artificielle qui intègrent la transparence, la responsabilité, la légalité, l'équité procédurale et la protection des renseignements personnels. Ces principes devraient s'appliquer à tous les programmes et à toutes les activités, existants et nouveaux, être inclus dans tout document d'appel d'offres des autorités publiques pour des contrats avec des tiers ou des systèmes d'intelligence artificielle fournis par des prestataires de services, et être utilisés pour évaluer les projets existants afin qu'ils soient mis en conformité dans un délai raisonnable.

- La nécessité pour le gouvernement de promouvoir le renforcement des capacités, la coopération et la mobilisation du public en matière d'intelligence artificielle. Cela devrait se faire par le biais d'initiatives d'éducation du public, en perfectionnant les connaissances et l'expertise en matière d'intelligence artificielle dans tous les ministères, en développant la capacité à soutenir la transmission des connaissances et l'expertise entre le gouvernement et les développeurs et vendeurs d'intelligence artificielle, et en établissant ou en développant la capacité à élaborer des ensembles de données de haute qualité en source ouverte pour former et tester ces systèmesNote de bas de page 32.

Dans un contexte où l'innovation axée sur l'intelligence artificielle tourne à plein régime au sein du secteur privé – et où l'industrie et les organisations gouvernementales se disputent un nombre limité de compétences spécialisées en intelligence artificielle, cette dernière recommandation est selon nous particulièrement importante pour souligner l'importance de renforcer les capacités du gouvernement plutôt que d'externaliser excessivement cette expertise en ayant recours à des entreprises privées pour des raisons de transparence. De plus, les aspects de la sensibilisation et de la mobilisation du rôle du gouvernement par rapport à une prise de conscience collective croissante et une meilleure compréhension, ainsi que le renforcement des connaissances politiques, sont aussi particulièrement importants.

Comme il est indiqué plus haut, des textes législatifs ont été proposés pour concevoir de nouveaux mécanismes politiques et réglementaires en vue d'une meilleure surveillance de l'industrie, comme le propose le projet de loi C-27 avec la création de la Loi sur l'intelligence artificielle et les données. L'un des objectifs louables de cette loi est d'interdire certaines conduites relativement aux systèmes d'intelligence artificielle qui peuvent causer un préjudice sérieux aux individus ou à leurs intérêts. Le champ d'application de la loi proposée n'est toutefois pas encore défini et se limite aux « systèmes à incidence élevéeNote de bas de page 33 », la définition de « système à incidence élevée » devant être établie dans la réglementationNote de bas de page 34. Le projet de loi prévoit également la création d'un poste de commissaire à l'intelligence artificielle et aux données au sein du ministère de l'Industrie (également connu sous le nom d'Innovation, Sciences et Développement économique Canada ou ISDE) qui, à défaut de désignation, contribuerait à l'application de la loi (au moyen de pouvoirs délégués par le ministre lui permettant de demander qu'on lui fournisse des documents, d'exiger des organisations qu'elles effectuent des vérifications, et d'ordonner la prise de mesures pour résoudre des problèmes et la cessation de l'utilisation de certains systèmes à incidence élevée lorsqu'il existe un risque grave de préjudice imminentNote de bas de page 35). Ce faisant, les capacités gouvernementales internes de compréhension et de réglementation de l'intelligence artificielle dans l'ensemble de la société doivent être considérablement renforcées, dans un souci d'ouverture et d'examen. Comme dans le cas du projet de loi sur la cybersécurité (projet de loi 26) qui y est étroitement lié, les questions de transparence sont essentielles pour comprendre et surveiller la portée et l'exécution de ces pouvoirs élargis.

En ce qui concerne l'exploitation et l'utilisation des systèmes d'intelligence artificielle par les acteurs du milieu de la sécurité nationale, nous observons que les principes fondamentaux du gouvernement du Canada contiennent des termes visant à « protéger » la sécurité et la défense nationales, ce qui pourrait nuire à l'ouverture. En effet, dans notre rapport de 2022, nous avons recommandé que les organismes canadiens chargés de la sécurité et de la défense adhèrent aux six principes directeurs de l'utilisation de l'intelligence artificielle définis par l'Organisation du traité de l'Atlantique Nord (OTAN) en 2021 (étroitement liés aux principes du gouvernement du Canada, mais conçus spécifiquement pour l'utilisation dans le domaine de la sécurité et de la défense).

Dans sa réponse publique à notre rapport de 2022, le SCRS déclare ce qui suit à propos de l'intelligence artificielle :

Le Service se rend pleinement compte de la puissance considérable de l'intelligence artificielle, y compris des risques et des possibilités qui y sont associés. Voilà pourquoi il a examiné attentivement cette partie du rapport et s'efforcera de collaborer activement avec des Canadiennes et des Canadiens et de tirer parti de leurs points de vue et de leur savoir-faire sur la questionNote de bas de page 36.

Cet engagement correspond étroitement à l'importance accordée à la mobilisation et à la sensibilisation du public par les commissaires à l'information et à la protection de la vie privée de la Colombie-Britannique et du Yukon (voir ci-dessus), et nous encourageons et saluons les efforts du SCRS et d'autres acteurs dans ce domaine important.

L'utilisation passée par la GRC de logiciels de reconnaissance faciale a suscité de vives controverses et témoigne à nouveau de l'importance de l'ouverture et de la mobilisation proactives, comme nous l'avons noté dans notre rapport de 2022, notamment en ce qui concerne les outils de Clearview AI et les préoccupations soulevées par le commissaire à la protection de la vie privée, qui ont entraîné la suspension de ces programmes.

Par conséquent, la GRC a mis au point un « programme national d'intégration des technologies » (en réponse directe à l'affaire Clearview) qui vise à « rendre plus transparents les processus qui régissent la façon dont la GRC […] approuve l'utilisation des technologies nouvelles et émergentesNote de bas de page 37. » Bien qu'il soit encourageant d'apprendre qu'une approche plus réfléchie et proactive est en cours d'élaboration, il sera important que la GRC fournisse de l'information transparente au public quant aux particularités du nouveau programme d'intégration qui aurait été créé en 2021 (outre une simple mention dans son plan ministériel 2022-2023Note de bas de page 38). Si toutes les activités menées dans le cadre du programme d'intégration sont secrètes, la transparence continuera à en pâtir.

En résumé, à mesure que l'utilisation de l'intelligence artificielle s'étend invariablement au sein du milieu de la sécurité nationale, il est essentiel que le public en sache plus sur les objectifs et les activités des diverses entités publiques (notamment le CST, le CCCS, l'ASFC, le SCRS et la GRC). Des mécanismes appropriés doivent être conçus et mis en œuvre pour renforcer l'ouverture systémique et proactive au sein du gouvernement, tout en permettant un contrôle et un examen externes. Si le gouvernement cherche à favoriser une plus grande transparence en ce qui a trait à l'utilisation de l'intelligence artificielle dans le secteur privé, il doit également le faire à l'interne. Les deux secteurs collaborant à l'atteinte d'objectifs communs en matière de sécurité nationale, l'ouverture et la mobilisation sont des moteurs essentiels d'innovation, d'adaptation et de confiance du public.

En revanche, le secret engendre la suspicion, et l'inertie bureaucratique interne entraîne des risques accrus de dysfonctionnement et de corruption, ainsi que des conséquences imprévues et des dommages systémiques découlant du déploiement de l'intelligence artificielle. L'Engagement de transparence en matière de sécurité nationale se veut donc un mécanisme permettant de renforcer l'ouverture et la mobilisation. Certaines recommandations spécifiques établissent un lien entre le développement de l'intelligence artificielle et les principes de l'Engagement de transparence en matière de sécurité nationale énoncés dans la troisième section du présent rapport.

2.4 Surveillance et chiffrement

Les techniques d'analyse de données reposant sur l'intelligence artificielle et d'autres techniques en constante évolution requièrent logiquement plusieurs autres pratiques qui méritent d'être examinées de plus près. L'une d'entre elles a retenu l'attention du public : la collecte de données de plus en plus vastes auprès de sources de plus en plus nombreuses, une pratique encouragée et facilitée par la numérisation massive de la vie quotidienne survenue au cours de la dernière décennie. Une autre est la conservation des données pour une durée indéterminée. Après avoir rencontré l'ASFC, le CST et le SCRS au cours des derniers mois, le GCT-SN a constaté qu'il est difficile d'obtenir des renseignements sur l'une ou l'autre de ces pratiques, en particulier sur la dernière. Il est nécessaire de faire preuve d'une plus grande transparence quant aux calendriers de conservation des données.

Le gouvernement du Canada a jugé bon d'élargir le pouvoir accordé aux institutions de sécurité et de leur permettre de recueillir et de conserver des données par le biais de la Loi concernant des questions de sécurité nationale, entrée en vigueur en 2019, ce qui a eu pour effet d'accroître la taille de l'espace marqué par un besoin de transparence. Cela dit, les modifications législatives de 2019 ont imposé quelques garde-fous, en particulier au SCRS. Ces mesures, associées à la création du Comité des parlementaires sur la sécurité nationale et le renseignement (CPSNR) (par l'entremise du projet de loi C-22), à la création de l'Office de surveillance des activités en matière de sécurité nationale et de renseignement et à l'établissement du poste de commissaire au renseignement, ont démontré un certain engagement en faveur de la transparence et de la responsabilité.

A) Transparence sur la gestion des données

Le GCT-SN est convaincu que les Canadiens bénéficieraient grandement d'information détaillée sur la façon dont la gestion des « ensembles de données » par le SCRS s'inscrit dans le mandat du Service et dans la politique de sécurité nationale du Canada. Au-delà des exigences strictes en matière de communication d'information au sein des canaux gouvernementaux ou aux organismes de surveillance, il existe toujours un besoin de transparence directe des politiques publiques et des pouvoirs exécutifs. La transparence des renseignements exige également de meilleurs liens entre la collecte, la conservation et l'analyse des données et l'environnement opérationnel objectif du Service. Les rapports annuels du SCRS contiennent actuellement des définitions et des classifications des menaces, mais aucune indication claire de la manière dont les menaces sont évaluées, comparées ou liées aux décisions stratégiques. Les rapports contiennent également peu d'information sur les activités du Service. Nous comprenons que le fait de révéler trop de choses sur les tâches, les méthodes ou les résultats des activités du Service nuirait à la sécurité nationale, une objection qui est d'ailleurs souvent entendue. Toutefois, la transparence des politiques et des pouvoirs exécutifs exige davantage que des considérations abstraites concernant les menaces ou des cas illustratifs spécialement sélectionnés.

B) Lumière sur les métadonnées